|

|

Новости

Статьи

Магазин

Драйвера

Контакты

RSS канал новостей

Программаторы 25 SPI FLASH

Адаптеры Optibay HDD Caddy

Драйвера nVidia GeForce

Драйвера AMD Radeon HD

Игры на DVD

Сравнение видеокарт

Сравнение процессоров

В конце марта компания ASRock анонсировала фирменную линейку графических ускорителей Phantom Gaming. ... Компания Huawei продолжает заниматься расширением фирменной линейки смартфонов Y Series. Очередное ... Компания Antec в своем очередном пресс-релизе анонсировала поставки фирменной серии блоков питания ... Компания Thermalright отчиталась о готовности нового высокопроизводительного процессорного кулера ... Компания Biostar сообщает в официальном пресс-релизе о готовности флагманской материнской платы ... |

АРХИВ СТАТЕЙ ЖУРНАЛА «МОЙ КОМПЬЮТЕР» ЗА 2003 ГОДОткрываем карты

Владимир СИРОТА vovsir@km.ru На сей раз мы забрасываем наш невод познания в бурлящее море рынка современных видеокарт. Что нам попадется? Так вот, посмотрим на улов… Шустро карта кадры строит, семплы разные крутя… Сказочное вступление — …

— Да пошел ты! — ответила ему Золотая Рыбка. И то ли махнув на прощанье хвостом, то ли продемонстрировав рыбий зад, скрылась в волнах. Опечалился старик. Но делать нечего. После того, как были расставлены все имевшиеся в словарном запасе точки над ё касательно рыбы вообще и золотой в частности, отправился старик домой. Приходит, а в избе за старой, засиженной мухами четверкой сидит бабка да пасьянс раскладывает… Конец этой грустной истории мог бы быть более счастливым, если бы действие происходило в наши дни — ведь просил-то старик у Золотой Рыбки не невесть что, а видеокарту приличную к своему компу, чтобы картинку показывала как взаправду, глаз стариковский радовала. Но чем могла в те времена помочь Рыбка — не было тогда таких карт. Вот и разругалась она со стариком. К счастью, нынешнее поколение компьютерщиков может рассчитывать на высококачественную графику. И пусть до настоящей Mother Nature последняя пока не дотягивает, однако прогресс заметен, так сказать, даже невооруженным глазом (рис. 1). Как делается красота Что делают видеокарты? Да в общем-то, современные 3D-акселераторы заняты одним и тем же делом. Получив расчетные «контрольные точки» кадра (рис. 2), они «укладывают» между полученными координатами плоскости-полигоны треугольной формы (рис. 3), на которые затем наносятся текстуры (рис. 4). После чего мы можем созерцать все прелести «реалистичного» изображения, в зависимости от количества полигонов и качества текстур. Согласен, это очень упрощенный взгляд на деятельность видеокарт, но суть верна. Однако в последнее время к последовательности этих действий добавились такие интересные вещи, как шейдеры (программы, описывающие некий алгоритм задания визуализации объекта), которые, в свою очередь, делятся на вершинные и пиксельные. Причем эти самые шейдеры все время эволюционируют. Дополнительных красот изображения видеокарты последнего поколения добиваются благодаря появлению возможности управления потоком команд для вершинных шейдеров. А также наличию программно управляемых пиксельных шейдеров с произвольным расположением команд. Конечно, шейдеры несовместимы сверху вниз со старыми видеокартами, поэтому рассчитывать на дополнительные красоты приходится лишь на современных видеоускорителях, о чем мы также далее поговорим.

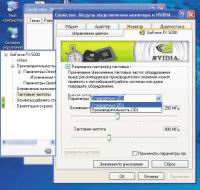

Суровая проза В нашем сегодняшнем обзоре мы попытаемся охарактеризовать рынок распространенных ныне в Украине видеоакселераторов как низкого ценового уровня, так и изделий класса hi-end. Смотрины наших видеокарт мы начнем с обзора характеристик видеочипов компании NVIDIA и видеокарт на их основе. Сразу оговорюсь, что практически все сделанные на совесть видеокарты разных производителей, базирующиеся на одних и тех же чипах и рекомендованном дизайне плат, при одинаковых частотных характеристиках, и использующих драйверы NVIDIA, не отличаются по производительности. «Родные», идущие в комплекте с видеокартами, «дрова», как правило, всегда «старые». К тому же, производитель иногда «дорабатывает» их с целью повысить производительность, зачастую в ущерб качеству изображения, поэтому пользоваться ими в нашем изыскании мы не будем. Сравнивать кучу карт на одинаковых чипах смысла нет. А вот сопоставить карточки с разными микросхемами, включая далеко не новые, но все еще доступные решения, — это как раз то, что нас интересует. Итак, приступим. В нашем обзоре присутствуют видеокарты GeForce 4 MX 440 и GeForce 4 Ti 4200, правда в версии, поддерживающей AGP 8x. Однако, поскольку об этих продуктах мы уже много писали (см. «GeForce’ированная семейка», МК, № 32 (203)), то повторяться не будем. А начнем сразу с нового, интересного поколения видеокарт, идущего на смену GeForce 4, — поколению GeForce FX. Семейка FX, или Новые отпрыски NVIDIA Несомненно, «выход в свет» GeForce FX, ознаменованный появлением модели FX 5800, нельзя назвать успешным. С чем и в самой NVIDIA, кстати, согласны. Но лиха беда начало — за ним последовали девайсы, составившие целое семейство GeForce FX, ныне представленное модельным рядом FX 5200, FX 5600 и FX 5900, включая Ultra-модификации этих видеокарт (то бишь разогнанные). И вот эти продукты, а не злополучный GeForce FX 5800 смогут в ближайшем будущем приобрести пользователи. Хотя, конечно, и «остатки» FX 5800, и его Ultra-варианта тоже можно будет при желании заполучить. Но обратимся, собственно, к эволюции линейки GeForce FX. Как же изменился рынок видеоакселераторов с появлением этого чипа? Анонсированный еще осенью прошлого года, GeForce FX 5800 и его вариант Ultra Пока посмотрим на характеристики нового чипа, известного и как NV30. Технология его производства — 0.13 микрон с использованием медных соединений. Чип насчитывает 125 млн. транзисторов, имеет 3 геометрических и 4 пиксельных процессоров, каждый из которых обладает двумя конвейеризированными блоками фильтрации текстур, двумя блоками выполнения арифметико-логических операций с целыми числами и одним блоком обработки чисел с плавающей запятой. Возможности обоих блоков превышают спецификации DirectX9 относительно вершинных и пиксельных шейдеров 2.0. Однако же, хорошего в этом мало. «Що занадто, то не здраво» — на моей памяти ни одна из «дополнительных» возможностей, периодически появлявшихся в чипах от NVIDIA, так и не оказалась востребованной. По простой причине — «игнорирования» этих возможностей очередным DirectX. Естественно, поддерживает карта «новомодный» интерфейс AGP 3.0 (он же AGP 8х). Реализован четырехканальный контроллер памяти, как и у предыдущих высокоуровневых моделей карт. Зато усовершенствованию подверглась техника экономии пропускной полосы памяти. Осуществляется полное сжатие буфера кадра (до 4:1), включая информацию о цвете, хотя и только в режимах MSAA, имеется и сжатие Z-буфера (т.е. информации о глубине). Сжатие буфера кадра позволяет уменьшить падение производительности при работе полноэкранного сглаживания. Введены тайловые оптимизации по кэшированию, сжатию и раннему отсечению невидимых поверхностей. Используются новые алгоритмы оптимизированной анизотропной фильтрации и антиалайсинга. Естественно, как же в такой карте без двух контроллеров дисплея, двух 400 МГц RAMDAC. А вот встроенные в чип три TDMS-канала для внешних DVI-чипов выглядят странным решением — не иначе лавры Matrox кому-то в NVIDIA не давали покоя? Кстати, сводные характеристики видеочипов можно посмотреть в В нашем обзоре GeForce FX 5800 представлена AOpen Aeolus (рис. 5). В целом о данной видеокарте можно сказать то же, что и о большинстве карточек на данном чипе. Она имеет большие размеры (занимает и слот AGP, и место ближайшего PCI) и систему охлаждения с довольно высоким уровнем шума. При включении видяшки ее кулер сначала раскручивается «по полной», причем процесс сопровождается звуком, напоминающим нечто среднее между работой пылесоса и взлетом реактивного авиалайнера. В штатном режиме видеокарта, правда, тише. Но переход в «нагруженный» задачами 3D-режим заставляет кулер вращаться сильнее (как известно, его скорость динамически изменяется в зависимости от температуры чипа), что приводит к повышению шуму. Сама плата довольно большая, с массивными радиаторами на видеочипе и микросхемах памяти, а уровень их энергопотребления требует дополнительного питания от БП. К достоинствам FX 5800, как, впрочем, и всей линейки FX-видеокарт, следует отнести возможность работы с различными тактовыми частотами в 2D- и 3D-режимах (рис. 6). Такой подход позволяет снизить энергопотребление и тепловыделение видеочипом при работе с двухмерной графикой. И что немаловажно, понизить уровень шума от «реактивного» кулера в случае с FX 5800. Характеристики представленных в обзоре видеокарт см. в таблице 2. Но все же, невзирая на прелести GeForce FX 5800, подлинно массовым продуктом ему быть не суждено. Как из-за высокой стоимости, так и по иным причинам. Настоящим же «народным» продуктом должны стать «младшие братья» этой видеокарты — GeForce FX 5200 и 5600.

FX’ики Но hi-end hi-end’ом, а максимальной популярностью у покупателей пользуются карты не сверхвысокого, а среднего и нижнего ценового уровня. И именно в этом сегменте рынка производители получают максимальные прибыли. Какая же ситуация складывается здесь? До недавнего времени в сегменте недорогих видеокарт властвовали всевозможные GeForce 4 MX. Однако, невзирая на цифру «4» в названии, по сравнению с предыдущим поколением GeForce 3, это был явный регресс. Ведь 4 МХ показывали не просто меньшую производительность, но и отставали в технологическом плане — их уделом была поддержка только DirectX7, хотя GeForce 3 уже «понимал» DirectX8.1. Эта «отсталость» заметна и в нашем обзоре: GeForce 4 MX 440-8х — единственная из карт-участниц, которая смогла выполнить из набора тестов 3D Mark 03 один лишь GT1 Wings of Fury (это как раз и есть DirectX7-тест). В основном это вызвано отсутствием поддержки пиксельных шейдеров версии 1.4, которые работают на всех остальных видеокартах. В общем, легко понять, что 4 MX оказался весьма неудачным «обрезком» полноценного GeForce 4, представленного линейкой Ti’таниумов. Поэтому интересно посмотреть, как же на фоне полноценного FX 5800 выглядят его младшие собратья FX 5200 и 5600. Конечно, некоторые производители будут устанавливать свои частоты чипа и памяти «младших» видеокарт, в зависимости от качества наличествующих комплектующих. Также ряд фирм уже представили заведомый отстой в лице FX 5200 с 64-битной шиной памяти. Но подобные отклонения от нормы — исключение из правил хорошего тона, поэтому таких поделок следует по возможности избегать. Нужно признать, что в сегменте недорогих DirectX9 видеокарт NVIDIA тоже отстала. До недавнего времени и здесь безраздельно властвовала ATI, что позволяло последней удерживать свои «недорогие» видяшки на довольно высоком ценовом уровне. К счастью, с приходом FX 5200 и 5600 все изменилось к лучшему — цены стремительно поползли вниз. И хоть NVIDIA не успела снять сливки в этом сегменте рынка из-за своего «опоздания», зато ведь пользователям какая радость — DirectX9-видеокарточки становятся доступнее буквально с каждым днем. «Бюджетные» платы GeForce FX будут представлены в следующих вариантах. Самый-самый —GeForce FX 5600 Ultra (чип — 350, память — 700 МГц DDR со 128-битной шиной). Чуть помедленнее будет просто GeForce FX 5600 (чип — 325, память — 550 МГц DDR при той же ширине шины памяти). Оба вышеназванных чипа базируются на графическом ядре NV31. В категории очень ценово привлекательных будут присутствовать GeForce FX 5200Ultra (325/650DDR МГц чип/память) и GeForce FX 5200 (250/400DDR МГц соответственно). Эти решения базируются уже на графическом ядре NV34 и обладают такой же 128-бит шиной памяти DDR SDRAM. Каковы же особенности удешевленных чипов, и сколь плохо на них сказалась«обрезка»? Попробуем разобраться. Самое, наверное, главное, что NVIDIA решила сохранить в FX5200 и 5600 весь базовый набор функций, присущих NV30. То есть «дешевые» полностью соответствуют требованиям DirectX9, хотя, по сравнению с NV30 и NV31, возможности вершинных и пиксельных процессоров NV34 «упрощены». Сохранилась и поддержка нового метода анизотропной фильтрации, в наличии полноценный мультисэмплинг. Тем не менее, некоторые особенности новых чипов весьма интересны. NV31 и NV34, по аналогии с NV30, имеют архитектуру, позволяющую при необходимости задействовать различное число пиксельных конвейеров. Но в то время как вариант NV34 по своим параметрам фактически представляет «половинку» NV30, то NV31 обзавелся и новыми характеристиками. Его структура позволяет использовать два варианта архитектуры вычислительных блоков. Первый из них — это применять два конвейера с двумя модулями обработки текстур в каждом (аналогично NV34). Второй вариант предусматривает использование 4-х конвейеров с одним текстурным блоком в каждом. Так вот, в последнем режиме на NV31 возможна запись в буфер кадра, чего не делают NV30 и NV34 при использовании «максимальных» 8-ми и 4-х конвейеров соответственно. Также «простой» NV34, в отличие от NV30 и NV31, не поддерживает технологию компрессии буфера кадра. Последнее отрицательно сказывается на скорости прорисовки сцен видеокартой при использовании режима полноэкранного сглаживания. У NV34 и NV31 абсолютно одинаковый аппаратный геометрический процессор, производительность которого более чем в два раза ниже, нежели у NV30. FX 5200 представлен в нашем обзоре видеокартой Sparkle GeForce FX 5200 VIVO 128 Мб DDR (рис. 7), а FX 5600 —AOpen Aeolus GeForce FX 5600 128 Мб DDR (рис. 8).

Работа над ошибками Учитывая «успехи» FX 5800, в середине мая сего года NVIDIA заявила о выходе нового своего видеочипа NV35, видеокарты на основе которого должны удовлетворить запросы притязательных (и состоятельных :-)) пользователей. Итак, был анонсирован выход GeForce FX 5900 и его варианта Ultra. Новые возможности, заложенные в этот чип, наконец-то позволят вернуть NVIDIA утраченное лидерство на рынке high-end-видеокарт. К сожалению, ко мне это «чудо» не добралось, но рассказать о нем можно. Итак, чем же таким NVIDIA «поборола» наконец ATI? По правде сказать, ничего особо нового миру явлено не было. По своей сути новый NV35 явился воплощением «доведенной до ума» архитектуры NV30. Для нового чипа был применен 256-битный контроллер памяти. А это резко повысило пиковую пропускную способность памяти (кто занимался оверклокингом видеокарт, знает не понаслышке, насколько критичным является данный параметр). Также вместо дорогостоящей DDR II появилась обычная DDR, что снизило не только себестоимость решения, но и тепловыделение :-). Помимо этого, в новом чипе подверглись улучшению алгоритмы компрессии текстур. По свидетельству самой NVIDIA, эти алгоритмы, названные Intellisample HCT (High Resolution compression Tecnology), позволяют на NV35 добиваться до 50% прироста производительности в «тяжелых» режимах, использующих полноэкранное сглаживание и анизотропную фильтрацию. NV35 архитектурно схож с NV30, у него отсутствует четкое разделение функциональных блоков пиксельного процессора на отдельные пиксельные конвейеры, и как и у его предшественника, в зависимости от ситуации образуется либо 4, либо 8 пиксельных конвейеров. Причем 8-конвейерная схема традиционно работает лишь тогда, когда не осуществляется запись в буфер кадра. (То есть это происходит при расчете Z-буфера или буфера шаблонов. В этом случае чип обрабатывает данные вдвое быстрее по сравнению со стандартным режимом построения кадра, когда он работает в «традиционном» режиме с четырьмя пиксельными конвейерами по 2 текстурных модуля на каждом. Подобный подход позволяет, например, удвоить скорость расчета теней.) Кстати, о тенях. Технология Ultra Shadow в NV35 усовершенствована: теперь при расчете теней можно установить граничные величины Z, за рамками которых вычисления не будут проводиться. Этим существенно улучшается производительность видеокарты при отрисовке сцен с использованием расчета теней в реальном времени. Также NVIDIA похваляется тем, что у нового чипа скорость выполнения операций с плавающей точкой (активно используемых в пиксельных шейдерах версии 2.0) возросла в два раза. К сожалению, представитель GeForce FX 5900 у нас отсутствует . ATI-баты, шли RADEON’ы (признаюсь, нескладно) А что же ATI? Как же она она отвечает на дерзкие попытки NVIDIA оккупировать рынок видеокарт? А вот как. Несомненно, хитом начала этого года стал Radeon 9700 и его версия Pro, впервые за многие годы позволившие ATI «задвинуть» изделия NVIDIA на второй план. Со знакомства с ним мы и начнем. Видеоакселераторы на основе графического ускорителя R300 —Radeon 9700 (чип — 275, память 540DDR МГц) и 9700Pro (325 и 620 МГц соответственно) безраздельно властвовали на рынке видеокарт около шести месяцев. Эти видеокарты были мощными как по производительности, так и по энергопотреблению — им требовалось подведение дополнительного питания от БП. Я приведу лишь краткие характеристики семейства Radeon 9700, поскольку более внимательно этот продукт мы рассматривали в отдельной статье (см. «ATI-новый чемпион» МК, № 40 (211)). Итак, чип R300, созданный на базе 0.15-мкм технологических норм производства, включает 107 миллионов транзисторов, имеет 4 вершинных конвейера и 8 пиксельных конвейеров, по 1 текстурному блоку на каждом. Ширина его шины DDR-памяти составляет 256 бит. Контроллер памяти четырехканальный (4 канала по 64 бит). Поддерживается интерфейс AGP 8x и полный набор возможностей DirectX9, включая, естественно, пиксельные и вершинные шейдеры версии 2.0. В наличии фирменная технология экономии пропускной полосы памяти HyperZ III и ранний Z-тест, позволяющий выполнять пиксельный шейдер только для видимых точек. Имеется аппаратное ускорение распаковки и сжатия видеопотока MPEG 1 Честь Radeon 9700 Pro у нас будет отстаивать произведенный Sapphire Radeon 9700Pro со 128 Мб DDR-памяти (рис. 9). Набирая силу Предваряя выход мощного GeForce FX 5900, ATI представила новое решение — линейку видеокарт Radeon 9800 (325/620DDR МГц чип/память) и 9800Pro (380/680DDR МГц чип/память), основанных на графическом чипе R350. Судя по ревизии ядра, Radeon 9800 — это что-то новое, а не просто разогнанный вариант Radeon 9700. Так в чем же отличия? Таковых немного, но они есть. Главным является наличие аппаратной оптимизации производительности при работе с двусторонним буфером шаблонов (дает прирост производительности в играх, использующих динамические тени на основе буфера шаблонов, типа DOOM III и т.д.). Еще одно усовершенствование затронуло пиксельные процессоры. Благодаря последнему появилась возможность сохранять в памяти видеокарты не только финальные значения цвета, рассчитанные пиксельным шейдером, но и промежуточные значения параметров, определяемых в ходе выполнения расчетов. Сие получило название F-буфера и дало В остальном характеристики Radeon 9800 аналогичны Radeon 9700. Разве еще только стоит отметить установку памяти DDR-II на вариант 9800Pro с 256 Мб. Впрочем, это сделает карточку на целых $100 дороже, так что такое решение вряд ли можно назвать разумным. Скорее всего, это просто маркетинговый ход, дескать, вот, у конкурентов есть продукт с DDR-II, а мы чем хуже… Представлен самый мощный на сегодня графический ускоритель ATI будет видеокартой HIS (Hitech Information System) Radeon 9800Pro 128 Мб DDR (рис. 10) с гордым названием Excalibur (видимо, он призван порубить на морскую капусту все NVIDIA’вские предложения :-)). Менее привлекательные, но обаятельные В этой части нашего повествования речь пойдет о Radeon’ах среднего уровня, лучшим из которых, безусловно, является Radeon 9500 Pro. Почему? Да все очень просто — на поверку он оказывается слегка заторможенным (275/540DDR МГц чип/память) Radeon 9700. Видимо, в категорию чипов этого уровня попадают не прошедшие тест на «зрелость» 9700-е. Правда, вот еще шину памяти таким чипам принудительно урезают до 128 бит, что существенно снижает ее пропускную способность. Впрочем, платы некоторых производителей позволяли восстановить справедливость (сейчас вроде бы ATI заставила прекратить это «безобразие», а жаль, так хотелось в нем В отличие от своего собрата, Radeon 9500 — не просто «заторможенный» вариант Pro-версии. Чаcтоты чипа и памяти остались на уровне родственника. Да и шина памяти та же, 128-битная (контроллер памяти всего двухканальный, по 64 бита на канал). Чем же «обделили» эту модель? А ей оставили всего четыре пиксельных конвейера, естественно, с одним текстурным блоком на каждом. Честь прошедшей «обрезание» модели перед нами защищает Sapphire Radeon 9500 64 Мб DDR (рис. 11). А вот Radeon 9600 (325/400DDR МГц чип/память) и его братец Pro (400/600 МГц соответственно) — это нечто новое. В этих моделях используется чип RV350 — первая микросхема от ATI, изготовленная по 0.13-мкм технологии. Последнее нововведение позволило снизить энергопотребление чипа (отпала необходимость во внешнем питании) и уменьшить его размеры, а значит, и стоимость изготовления. К сожалению, представителя Radeon 9600 под рукой не оказалось . Дешево и сердито Модельки Radeon 9200 (250/200 МГц чип/память) и Pro (275/550DDR МГц) возглавляют ныне линейку low-end видеокарт от ATI. На самом деле они представляют собой Radeon’ы 9000 и 9000Pro, «осчастливленные» наличием AGP 8x (чип RV280). В связи с этим необходимо четко отдавать себе отчет в том, что по производительности такие модели не дотягивают до «менее цифроватого» Radeon 9100, который есмь инкарнация Radeon 8500LE. Зато, в отличие от GeForce 4 MX, эти видяшки полностью поддерживают DirectX 8.1 и знают о наличии пиксельных шейдеров 1.4. Представляет данную группу в нашем тестировании —Sapphire Radeon 9200 64 Мб DDR (рис. 12). Что сказать о таком «варианте»? Ну просто полный low-end — взгляните на тестовые Radeon 9100 (250/500 МГц чип/память), хоть и меньше по «старшинству», зато его производительность куда лучше 9200-х. Объясняется это просто — наличием двух конвейеров вершинных шейдеров и четырех пиксельных конвейеров с двумя текстурными блоками на каждом. Плюс двухканальный (2х64 бит) контроллер DDR-памяти. Полная аппаратная поддержка DirectX 8.1. Поскольку о Radeon 8500 мы писали подробно (см. И.Бежевец, «Гонки среди тяжеловесов», МК, № 29 (200)), то более о нем ни слова. И в самом низу иерархической лестницы ATI’шных видеокарт расположился Radeon 9000 (250/400DDR МГц чип/память) и его Pro (275/550 МГц) вариант. Созданы на чипе RV250, память DDR на 128-битной шине. Одноканальный, естественно, 128-бит контроллер памяти. Четыре пиксельных конвейера с одним текстурным блоком на конвейере. Поддержка вершинных шейдеров 1.1 и пиксельных 1.4. Соответствие запросам DirectX 8.1. Позиционировался как замена Radeon 7500, который в свою очередь является не слишком модернизированной :-) версией самого первого Radeon. Наличие второго RAMDAC вряд ли способно предотвратить переключение вашего внимания на более производительные решения. Ну разве только с финансами у вас туговато. Так, разобравшись с теорией, переходим к практике. Практические занятия Первым делом, особенности нашей тестовой платформы: одна из видеокарт, процессор Pentium 4 3.06 ГГц, плата Intel D850EMV2 (i850E), 2х256 Мб модуля памяти PC 1066 RDRAM Samsung, HDD Seagate Barracuda ATA IV 40 Гб 7200 об/мин, ОС Windows XP Professional. В зависимости от видеокрты устанавливались драйверы ATI CATALYST 3.4 или Detonator FX 44.03. Проводить наше тестирование мы будем вполне традиционно, для чего используем тест 3DMark03 и демо из игры Quake III. По ходу получения некоторых результатов в 3DMark03, мы будем их «слегка» комментировать. Quake III по большей части оставим без сопроводительных изысков, так как в OpenGL-приложениях царит гораздо больший бардак — здесь разработчикам приходится, оптимизируя, переписывать код едва ли не под каждый тип видеокарты. Итак, сначала проводим общие замеры производительности видеокарт с настройками драйверов, установленными по умолчанию. Результаты этих замеров приведены на диаграммах 1, 2, 3, 4 и 5. Общий итог в баллах по тесту 3DMark03 не дается, так как он вычисляется по формуле 3DMark score = (GT1fps х 7.3) + (GT2fps х 37) + (GT3fps х 47.1) + (GT4fps х 38.7), где, например, GT1fps — среднее значение кадров/с, измеренное в соответствующем игровом тесте. А поскольку многие видеокарты из-за аппаратных ограничений не могут пройти все тесты (на диаграммах я повыставлял в соответствующих местах нули, чтобы родина знала своих героев), то и сравнение сие будет не совсем корректно.

По полученным результатам мы можем констатировать следующие интересности. Из таблицы 3 видно, как снижается производительность видеокарт в различных графических режимах. Максимальному снижению быстродействия при повышении «уровня» графики подвержены видеокарты низкого и среднего ценового (и такого же по производительности) диапазона. В DirectX, при простом увеличении количества отображаемых пикселей в два с половиной раза (именно это случается при росте разрешения с 640х480 до 1024х768), они теряют примерно 35–40% своего быстродействия (то есть из каждых отображаемых в единицу времени 100 кадров остается 65–60).

Кстати, лично я считаю режим 1024х768 наиболее интересным — с ним одинаково комфортно можно играть как на 15-, так и на 20-дюймовом мониторе (ведь не для работы же, в конце концов, мы покупаем видеоакселераторы). А качество отрисовки графики в этом режиме высокого разрешения, даже при скромном сглаживании и анизотропии, весьма высоко. Помимо того, данное разрешение не очень «напрягает» современные видеокарты, а потому и играбельность не страдает. Рекомендуем ещё прочитать:

|

|

|

| Хостинг на серверах в Украине, США и Германии. | © sector.biz.ua 2006-2015 design by Vadim Popov |

Идёт загрузка...

Идёт загрузка...